近日,太阳成集团tyc33455王玲玲副教授团队在人工智能安全领域取得了新进展。其三项研究成果DeSA、EIV-CNN和HadAGG分别发表在IEEE Transactions on Information Forensics & Security(TIFS), IEEE Transactions on Dependable and Secure Computing(TDSC)和IEEE Transactions on Network Science and Engineering (TNSE)。其中, TIFS和TDSC是IEEE旗下信息安全领域的顶级期刊,入选中国计算机学会(CCF)推荐的A类国际期刊和中科院一区TOP期刊。

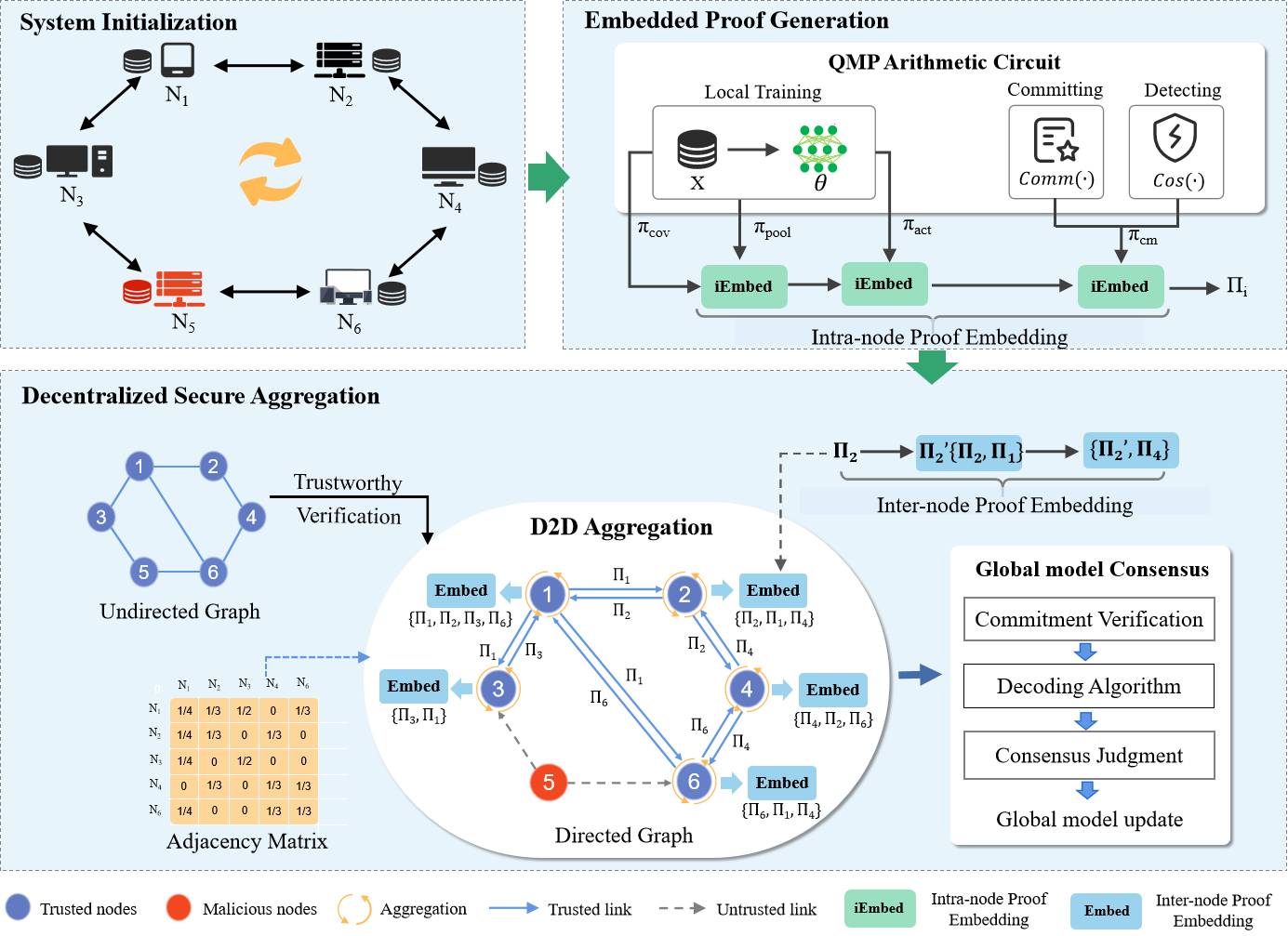

(1) 成果1:DeSA: Decentralized Secure Aggregation for Federated Learning in Zero-Trust D2D Networks. 安全聚合作为联邦学习领域的核心隐私保护技术,既能确保本地模型更新的机密性,又能实现全局模型聚合。在设备直连的去中心化联邦学习场景中,由于缺少中央服务器,特别是在易遭受拜占庭攻击的零信任网络环境下,现有去中心化安全聚合机制面临诸多技术难题与安全挑战。为此,项目组提出一种具备抗拜占庭攻击能力的新型去中心化安全聚合协议。经理论与实验验证,所提方案在正确性和综合性能上均展现出明显优越性。

图1. DeSA的工作流程图

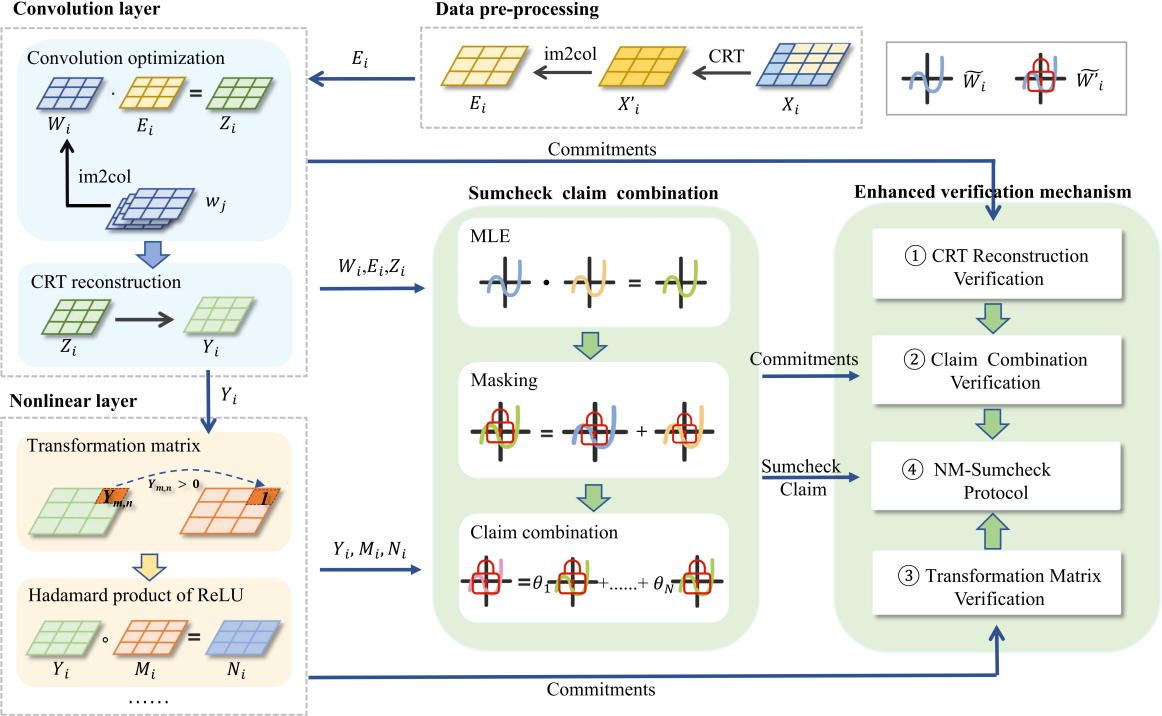

(2) 成果2:Enhancing Integrity Verification of Convolutional Neural Network Predictions in a Malicious Model (EIV-CNN). 神经网络的广泛应用,使得模型预测的完整性与隐私保护问题在恶意环境下备受关注。现有方法已尝试运用零知识证明技术进行完整性验证,但存在运行效率低下、难以对非线性运算进行严格完整性验证等问题。为此,项目组提出了恶意模型下增强卷积神经网络预测的完整性验证框架。理论和实验分析证明了项目组所提方案的正确性和优越性。

图2. EIV-CNN的工作流程图

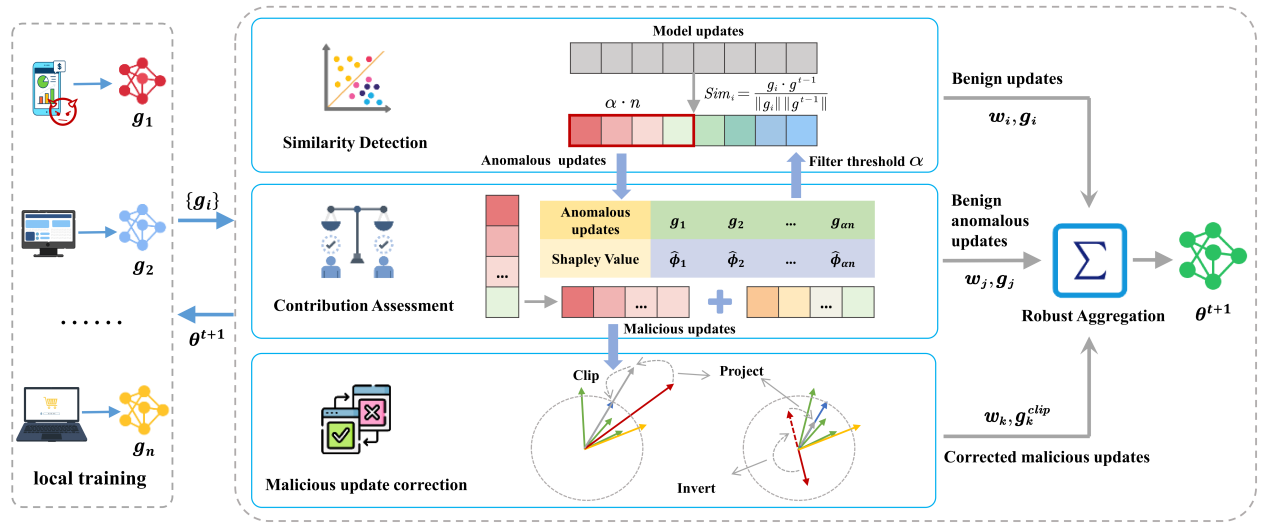

(3) 成果3:“Malicious or Benign?”: Enhancing the Contribution of Model Updates in Byzantine-Robust Heterogeneous Federated Learning (HadAGG). 拜占庭鲁棒联邦学习能够让服务提供商在部分参与者存在恶意行为的情况下,仍可训练得到精准的全局模型。现有针对拜占庭鲁棒联邦学习研究主要依靠服务器对客户端上传的模型更新进行统计分析,在聚合前过滤掉异常更新,以此优化全局模型。然而,在拜占庭攻击与数据异构环境并存的场景下,现有防御机制难以有效区分良性异常更新与恶意更新,进而削弱模型的泛化能力。针对上述问题,项目组提出了一种基于混合异常检测的拜占庭鲁棒聚合方案,并对该方案开展了系统的理论分析与全面的实验评估。

图3. HadAGG的工作流程图

上述成果主要完成人为王玲玲副教授和信息学院2021级硕士研究生陆忠锴(西电24级博)、2023级硕士研究生孙艺桐(拟赴西电26级博)和2023级硕士研究生张玉兴(已签约国家重点高新技术企业),唯一通讯作者均为王玲玲副教授。本研究得到了国家自然科学基金、山东省自然科学基金面上项目等多方资助。

[1] Lingling Wang*, Zhongkai Lu, Meng Li, Jingjing Wang, Keke Gai, and Xiaofeng Chen. DeSA: Decentralized Secure Aggregation for Federated Learning in Zero-Trust D2D Networks. IEEE Transactions on Information Forensics and Security(TIFS), 2026, 21(1): 1987-2001. (SCI, 中科院1区Top, CCF A )

[2] Lingling Wang*, YiTong Sun, Zhongkai Lu, Meng Li, Jingjing Wang, and Huaqun Wang. Enhancing Integrity Verification of Convolutional Neural Network Predictions in a Malicious Model[J]. IEEE Transactions on Dependable and Secure Computing(TDSC), 2026. DOI: 10.1109/TDSC.2026.3687141. (SCI, 中科院1区Top, CCF A )

[3] Yuxing Zhang, Lingling Wang*, Meng Li, Keke Gai, and Jingjing Wang. “Malicious or Benign?”: Enhancing the Contribution of Model Updates in Byzantine-Robust Heterogeneous Federated Learning. IEEE Transactions on Network Science and Engineering(TNSE), 2026, 13: 6027-6040. (SCI, JCR Q1, 中科院1区)

(一审:王玲玲,二审:马天晨,三审:陶冶)